您的位置:主页 > 公司动态 > 公司新闻 > 公司新闻

Sora的最强竞争对手,来自中国-国际黄金

今年2月宣布的Sora,先是引得业界“哇声一片”,马斯克直接亮相「人类愿赌服输」;周鸿祎说借助Sora人类实现AGI将缩减至一两年。

大佬的彩虹屁不是白吹的。行使Diffusion Transformer架构,Sora借助图像处置、空间关系、物理纪律、因果逻辑等纪律与知识,在十几秒、几十秒的视频中完成对现实天下的解构与再造。

但没过多久人们就发现,再多的“哇声一片”也改变不了Sora算法闭源的事实,意味着它无法复现。留给外界的是一道单选题:要么加入,要么自研。

1

变局

在Sora宣布后两个月,大洋彼岸突然有一家初创公司,与清华大学联手,推出了一款号称“继Sora后*完成突破的视频大模子”——Vidu。

这是中国*长时长、高一致性、高动态性的视频大模子。在官方先容中,Vidu接纳原创U-ViT架构,连系Difusion与Transformer手艺,能够一键天生长达16秒、1080P分辨率的高清视频。

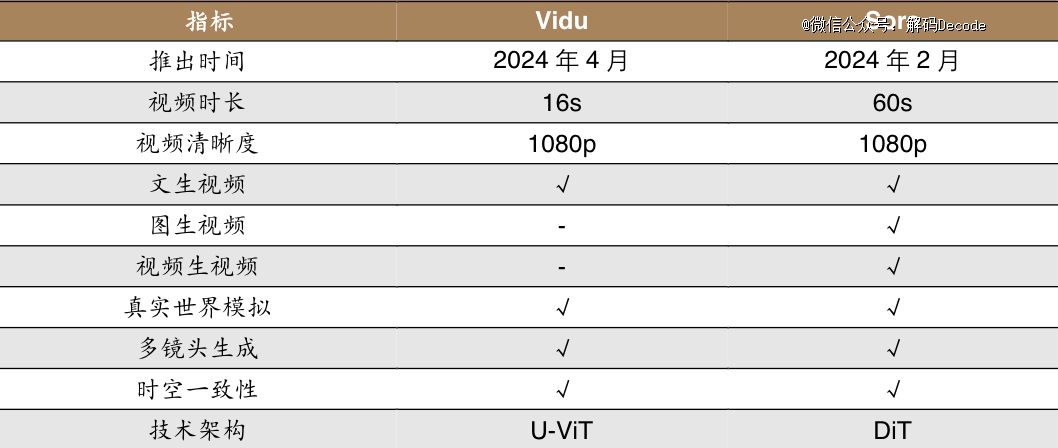

在对标Sora的性能指标里,Vidu也只有在时长和图/视频生视频上不敌。根据业内的评价,Vidu性能直接对标国际*水平,并在加速迭代提升中。

从Vidu放出的官方视频来看,它险些展示了视频大模子需具备的所有焦点能力:多镜头天生、模拟真实天下、保持时空一致性、厚实的想象力,以及让老外难以搞懂的中国元素。

作为“镜头语言”,多镜头天生是视频大模子的一堂必修课。现有的AI天生视频,大多都只包罗了稍微幅度的推、拉、移等简朴镜头,镜头语言单调而且也没什么叙事感,这是硬伤。

究其缘故原由,是由于现有视频内容沿用的手艺路径大多通过图片的插帧和拼接而成,无法完发展时序的连贯展望。

Vidu似乎没有上述问题,不仅能够围绕统一主体在一段画面里实现远、中、近景、特写等多样化镜头切换,还能直接天生转场、追焦、长镜头等效果,包罗能够天生影视级的镜头画面。

AI视频天生的另一个难题是,较难突破画面时空一致性与场景。什么是画面时空一致性,翻译过来就是在没有任何转场的情形下不能突变。一个典型的例子就是某些大模子的视频中,一只猫走着走着就酿成了6只脚。

Vidu在一定水平上也战胜了这个问题,最少从它天生的一段“带珍珠耳饰的猫”的视频中可以看到,随着镜头的移动,作为画面主体的猫在3D空间下能够一直保持衣饰、神色、模态的一致,视频整体看上去异常的连贯、统一和流通。

模拟真实物理天下运动同样是视频大模子的焦点,Vidu在对外放出的展示视频中,有一段显著是瞄着Sora打:模拟“一辆老式SUV行驶在山坡上”,Vidu的显示堪称*,灰尘、光影、靠山等细节与真实天下中人类的感知险些无差。

在对不存在的超现实主义画面解构上,Vidu也能做到“合理的奇幻”。例如,“风帆”、“海浪”能够合理地泛起在画室里,而且海浪与风帆的整体交互靠山异常适当自然。

固然,作为本土团队开发的视频大模子,Vidu对中国元素的明白远超那些入口货,好比熊猫、龙、宫殿场景等。

德邦证券在一份研报中给予了Vidu高度评价:

虽然在视频时长、视频效果、支持模态多样性等方面相比Sora仍有提升空间,然则在以镜头语言为代表的动态性,以及对物理天下纪律的明白与模拟能力等方面已做到了Sora相近水平。

最后还不忘给Vidu贴上一个鲶鱼标签,意思是它或将激励国产多模态大模子突破创新。那么问题来了,凭什么是Vidu?

2

U-ViT架构

佐力药业断臂重生,俞老板仍在局中

Vidu背后的生数科技,并不是一家名不见经初创企业。

OpenAI曾披露过一份手艺讲述,显示Sora的焦点手艺架构源自一篇名为《Scalable Diffusion Models with Transformers》的论文,论文提出了一个将 Diffusion(扩散模子)和 Transformer融合的架构——DiT,也就是后面被Sora接纳的谁人。

而在DiT提出前两个月,清华团队就提出了用Transformer替换基于CNN的U-Net的网络架构U-ViT,也就是Vidu接纳的谁人。甚至,据极客公园报道,由于U-ViT更早宣布,盘算机视觉顶会CVPR 2023收录了清华大学的U-ViT论文,却以「缺乏创新」为由拒稿了Sora底层使用的DiT论文。

生数科技的焦点团队就源于清华大学该论文团队,CTO鲍凡正是该篇论文的一作。严酷意义说,Vidu并不是“国产Sora”,而是一棵树上的两朵花。

之所Vidu能在两个月内快速突破16s流通视频天生,焦点就在于团队对U-ViT架构的深入明白以及耐久积累的工程与数据履历。而且据透露,3月份内部就实现了8秒的视频天生,紧接着4月份就突破了16s天生。

简朴来说,在架构上U-ViT也是Diffusion和Transformer融合的架构,路径以及部门结论都是相似的

U-ViT与DiT二者均提出了将Transformer与扩散模子融合的思绪,即以Transformer的网络架构替换基于CNN的U-Net架构,而且详细的实验路径也是一致的。好比,二者接纳了相同的patch embedding、patch size;二者得出了同样的结论:patch size为2*2是最理想的。

差异于接纳插帧等处置长视频的方式,U-ViT架构在感官上注重“一镜到底”,视频质量更为连贯与自然。从底层来看,这是一种“一步到位”的实现方式,基于单一模子完全端到端天生,不涉及中央的插帧和其他多步骤的处置,文本到视频的转换是直接且延续的。

有了理论支持,就要考研团队的工程化能力了。所谓工程化,抽象点说就是增强产物的架构设计,提升产物模块的复用性和扩展性。

2023年3月,基于U-ViT架构,生数科技团队开源了全球*基于U-ViT融合架构的多模态扩散模子UniDiffuser,率先完成了U-ViT架构的大规模可扩展性验证,比同样DiT架构的Stable Diffusion 3*了一年。

UniDiffuser是在大规模图文数据集LAION-5B上训练出的近10亿参数目模子,支持图文模态间的随便天生和转换,具有较强的扩展性。简朴来讲,除了单向的文生图,还能实现图生文、图文团结天生、无条件图文天生、图文改写等多种功效。

视频本质是图片的聚集,实现图像在时间维度的扩增,这使得图文义务取得的功效往往可以在视频领域复用。

例如,Sora接纳了DALL・E 3的重标注手艺,通过为视觉训练数据天生详细的形貌,使模子能够加倍准确地遵照用户的文本指令天生视频。Vidu同样复用了生数科技在图文领域的众多履历,靠的就是扎实的工程化能力。

凭证甲子光年,生数科技团队通过视频数据压缩手艺降低输入数据的序列维度,同时接纳自研的漫衍式训练框架,在保证盘算精度的同时,通讯效率提升1倍,显存开销降低80%,训练速率累计提升40倍。

现在,Vidu仍在加速迭代,未来将从图义务的统一到融合视频能力连续升级,天真的模子架构也将能够兼容更普遍的多模态能力。

3

加速向应用端延伸

以Open AI与Google为代表的科技巨头,正在外洋掀起一场多模态“军备竞赛”,而*的目的之一正是视频领域的加速迭代。

先是OpenAI CEO年头麋集“剧透”GPT-5,相比GPT-4实现周全升级,其中将支持文本、图像、代码和视频功效,或将实现真正的多模态。紧接着就是2月宣布的Sora,能够凭证文本指令或静态图像天生1分钟的视频。

Google也不遑多让,推出的原生多模态大模子Gemini可泛化并无缝地明白、操作和组合差异种其余信息。而2月推出的Gemini 1.5 Pro,则使用MoE架构首破100万极限上下文纪录,可单次处置包罗1小时的视频、11小时的音频、跨越3万行代码或跨越70万个单词的代码库。

海内也不甘人后,除生数科技宣布Vidu外,潞晨科技对其开源文生视频模子Open-Sora 举行了大更新,现在可天生16秒,分辨率720P的视频。同时具备可以处置任何宽高比的文本到图像、文本到视频、图像到视频、视频到视频和无限长视频的多模态功效,性能加速向Sora靠齐。

而海内外疯狂押注的底层逻辑是,多模态提升了大模子的泛化能力,在多元信息环境下实现了“多专多能”。多模态尤其是视频大模子的成熟成为奠基AIGC应用普及的基础,在垂直领域具有广漠的应用场景和市场价值。

好比上个月Adobe就宣布,将Sora、Pika、Runway等集成在视频剪辑软件Premiere Pro中。在宣布短片中,Premiere Pro展现出了在视频中添加物体、消除物体以及天生视频片断等能力。

通过AI驱动的音频功效已普遍可用,可使音频的编辑更快、更轻松、更直观。而AI驱动的视频功效,将是多模态大模子在AIGC应用融合中的主要实验,更深层的意义是,它或将催生未来更多征象级应用的开发。